امنیت عصبی (Neurosecurity): لایه حفاظتی هویت انسان در عصر نوروتکنولوژی

از Brainjacking تا نظارت عصبی: نوروتکنولوژی چگونه میتواند با لایه امنیت عصبی ایمن شود؟

لایه حفاظتی هویت انسان در عصر نوروتکنولوژی

امنیت عصبی: راهبرد چندلایه برای حفاظت از دادههای خام مغزی؛ تضمین نوآوری مسئولانه در بازار ۲۴ میلیارد دلاری نوروتکنولوژی

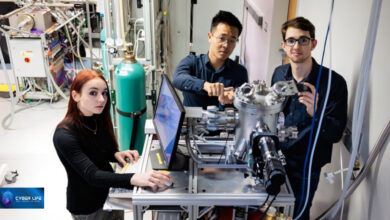

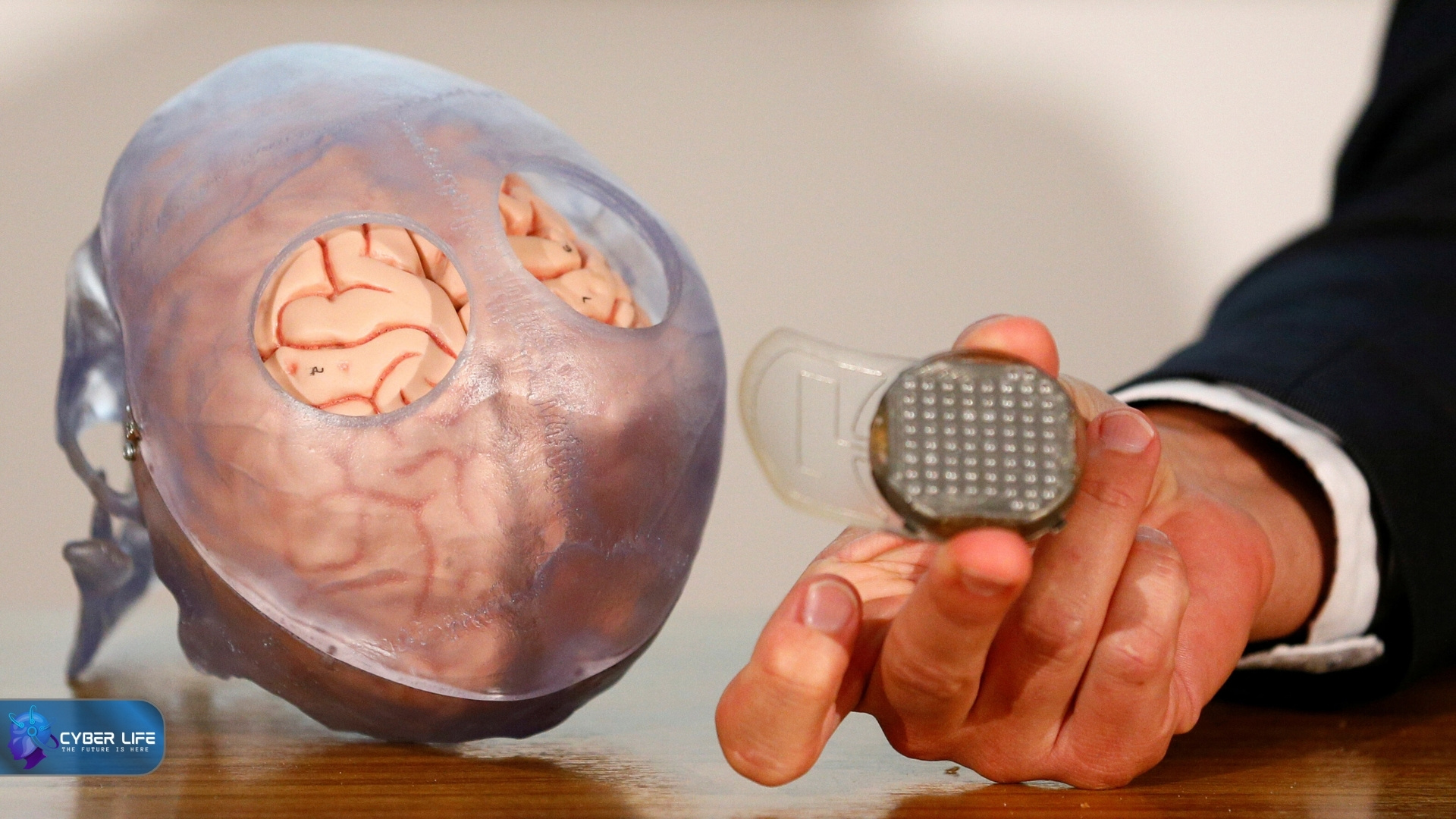

تکنولوژی عصبی (Neurotechnology) دیگر محدود به آزمایشگاههای تحقیقاتی و صفحات داستانهای علمی-تخیلی نیست؛ این حوزه با سرعتی خیرهکننده در حال پیشروی است. از ایمپلنتهای مغزی که توانایی حرکت را به افراد دچار فلج بازمیگردانند تا دستگاههای مصرفی که وعده افزایش تمرکز یا کاهش استرس را میدهند، نوروتکنولوژی پتانسیل تحول آفرینی عظیمی را برای پیشرفت بشر به همراه دارد. در واقع، بازار جهانی نوروتکنولوژی تا سال ۲۰۳۰ بیش از ۲۴ میلیارد دلار پیشبینی شده است و با نرخهای دو رقمی در حال رشد است. این رشد عظیم، اگرچه پر از فرصت است، اما نیاز فوری به تدوین یک چارچوب امنیت و حکمرانی دقیق را برای مقابله با ریسکهای جدید مطرح میسازد. همانطور که تام آکسلی (Tom Oxley)، مدیرعامل شرکت Synchron و یکی از رؤسای شورای آینده جهانی نوروتکنولوژی مجمع جهانی اقتصاد، تأکید کرده است: «اگر ما حکمرانی و امنیت را درست انجام دهیم، نوروتکنولوژی میتواند به یکی از تحولآفرینترین ابزارها برای پیشرفت انسان تبدیل شود». این واقعیت دوگانه – وعده استثنایی مشروط به امنیت و اعتماد – وضعیت کنونی این حوزه را تعریف میکند

سایبرکست قسمت 58 :لایه حفاظتی هویت انسان در عصر نوروتکنولوژی

لایه امنیت عصبی

بیش از ۷۰ درصد دستگاههای نوروتکنولوژی تجاری آسیبپذیرند؛ تهدیداتی مانند «مغزربایی» (Brainjacking) به واقعیت پیوستهاند

چرا «دادههای عصبی» با هر داده دیگری متفاوت

دلیل اصلی نیاز به یک لایه حفاظتی تخصصی به نام «امنیت عصبی» (Neurosecurity)، ماهیت فوقالعاده حساس دادههایی است که توسط این ابزارها تولید میشود. است؟برخلاف رمزهای عبور، اثر انگشت یا DNA، دادههای عصبی (Neural Data) به نوعی معماری پنهان اندیشه انسان را افشا میکنند. پیشرفتهای اخیر به ایمپلنتهای مغزی اجازه داده است تا گفتار خاموش را رمزگشایی کنند و مدلهای هوش مصنوعی (AI) تجربیات بصری فرد را بازسازی نمایند. این دادهها، احساسات، نیات و تصمیمات فرد را فاش میسازند. نکته حیاتی این است که برخلاف رمز عبور، اگر این دادهها به خطر بیفتند، قابلیت بازنشانی ندارند. این آسیبپذیریها دیگر صرفاً حدس و گمان نیستند؛ در حال حاضر، بیش از ۷۰ درصد از دستگاههای نوروتکنولوژی تجاری حاوی آسیبپذیریهای قابل سوءاستفاده هستند. این امر تهدیداتی را که قبلاً تخیلی به نظر میرسیدند—مانند «مغزربایی» (Brainjacking)، دستکاری شناختی و نظارت عصبی (Neuro-surveillance)—به واقعیت تبدیل میکند، بهویژه با پیشرفت رمزگشاییهای مبتنی بر هوش مصنوعی.

گستره فزاینده تهدیدات در اکوسیستم نوروتکنولوژی

اکوسیستم نوروتکنولوژی اکنون حوزههای گستردهای از جمله مراقبتهای بهداشتی، بازارهای مصرفکننده، دفاع و آموزش را در بر میگیرد. در بخش پزشکی، ایمپلنتهایی مانند تحریککنندههای عمیق مغزی (DBS) عملکرد بیمار را بازیابی میکنند، اما نشان داده شده است که در صورت عدم وجود تدابیر حفاظتی، در برابر بهرهبرداریهای بیسیم آسیبپذیر هستند. در بازارهای مصرفی، دستگاههای واسط مغز و رایانه (BCI) برای بازی، سلامتی یا بهرهوری، اغلب از طریق بلوتوث یا وایفای متصل میشوند، که آنها را در معرض حملاتی مانند جعل (Spoofing) و ربایش (Hijacking) قرار میدهد. حتی رمزگشاییکنندههای عصبی مبتنی بر هوش مصنوعی که میتوانند گفتار، تصاویر و حالات عاطفی را از سیگنالهای مغزی بازسازی کنند، در برابر حملات معکوسسازی و حملات متخاصم (Adversarial Attacks) آسیبپذیر هستند که میتوانند خروجیهای کاذب تولید کنند. پلتفرمهای متصل به ابر (Cloud-linked) نیز این ریسکها را تشدید میکنند و دادههای عصبی را در معرض باجافزارها، به خطر افتادن زنجیره تأمین، و نظارت برونمرزی قرار میدهند. با توجه به این گستردگی، درس آموخته واضح است: وعده نوروتکنولوژی را نمیتوان از آسیبپذیریهای آن جدا کرد و حفاظت باید تمام پشته (Stack) را، از تراشه تا ابر، و از ایمپلنتها تا گجتهای پوشیدنی، در برگیرد.

نیاز به چارچوب جامع: «لایه امنیت عصبی»

تأمین امنیت نوروتکنولوژی را نمیتوان تنها با یک تدبیر حفاظتی محقق کرد؛ این کار مستلزم یک اکوسیستم لایهبندی شده از محافظتها است که انعطافپذیری فنی را با حکمرانی مؤثر ترکیب میکند. متأسفانه، در حالی که ایمپلنتهای پزشکی تحت مقررات خاصی هستند، نوروتک مصرفی (هدستهای سلامتی، BCIهای بازی) همچنان در منطقه خاکستری نظارتی باقی ماندهاند. بدون تدابیر حفاظتی جهانی، خطر پیشرفت نوروتکنولوژی بدون حفظ ماهیت هویت انسانی وجود دارد.

در هسته این چارچوب امنیتی، حکمرانی دادههای عصبی (Neurodata Governance) قرار دارد؛ یعنی رفتار با دادههای مغزی به عنوان زیرساخت حیاتی، با تمرکز بر شفافیت، رضایت آگاهانه و بهحداقلرسانی سختگیرانه دادهها.

ساختارهای دفاعی تخصصی در لایه امنیت عصبی

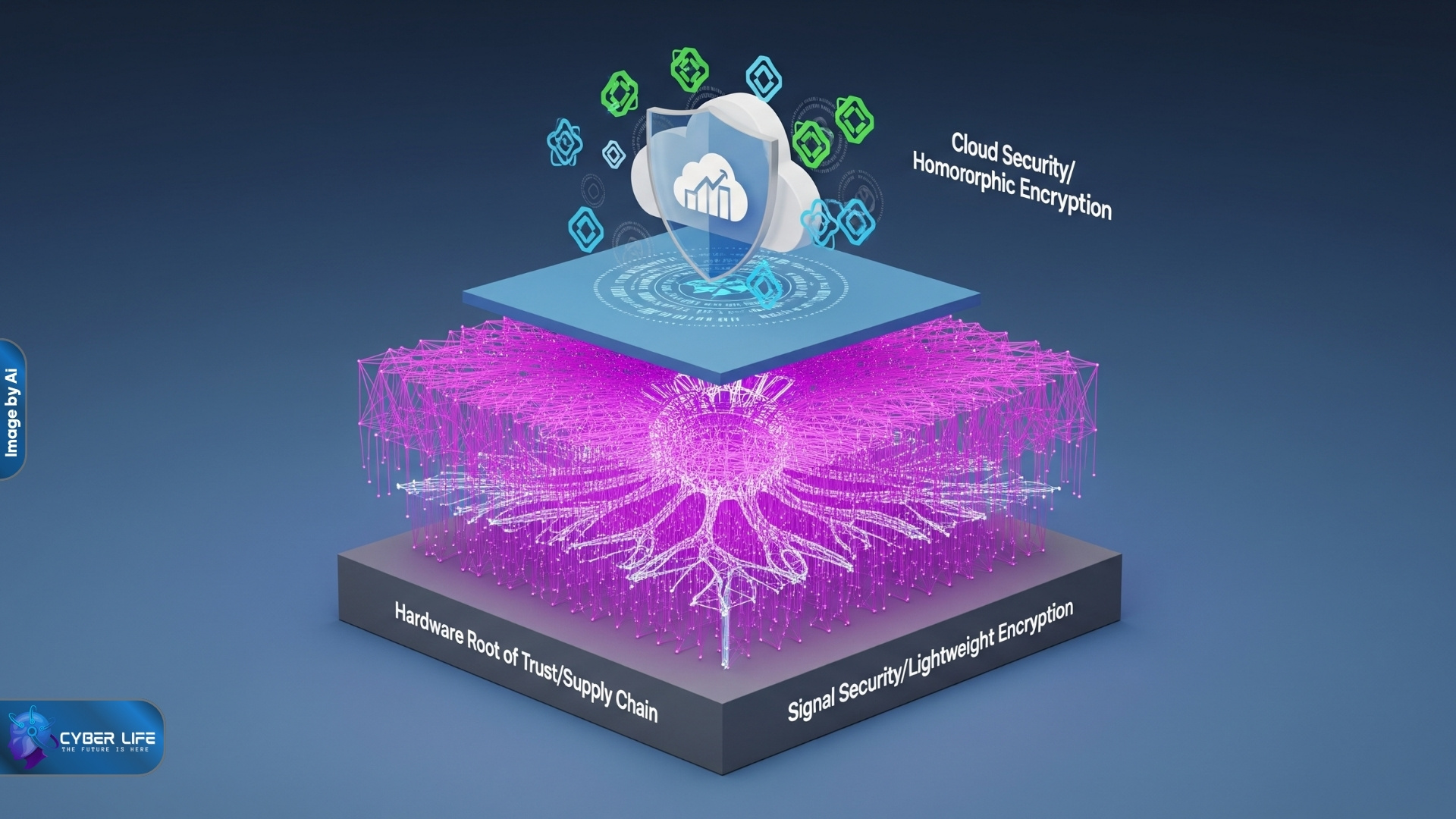

برای ایجاد یک مشارکت قابل اعتماد بین انسان و ماشین، باید یک اکوسیستم امنیتی تخصصی برای حفاظت از دستگاهها، مدلهای هوش مصنوعی و خطوط لوله ابری ایجاد شود. این حفاظتهای چندلایه عبارتند از:

- امنیت سیگنال (Signal Security): حفاظت باید در سطح سیگنال مغزی اعمال شود. این امر مستلزم استفاده از رمزگذاری سبکوزن، احراز هویت و امضاهای دیجیتالی برای جلوگیری از جعل یا تزریق سیگنالهای مخرب است که باید از طریق آزمایش تیم قرمز (Red-teaming) معتبر شوند.

- امنیت هوش مصنوعی (AI Security): از آنجایی که هوش مصنوعی نقش کلیدی در رمزگشایی سیگنالهای عصبی دارد، مدلها باید تحت تست متخاصم، ممیزیهای سوگیری، قابلیت توضیح (Explainability) و نشانهگذاری آب رمزنگاری (Cryptographic Watermarking) برای اطمینان از یکپارچگی مدل قرار گیرند.

- امنیت ابر و لبه (Cloud and Edge Systems): سیستمها باید پردازش محلی را در اولویت قرار دهند و وابستگیهای ابری را از طریق رمزگذاریهای پیشرفته مانند رمزگذاری متقارن، رمزنگاری پساکوانتومی (Post-quantum Cryptography) و رمزگذاری همومورفیک (Homomorphic Encryption) که امکان تجزیه و تحلیل حفظکننده حریم خصوصی را فراهم میکند، ایمن سازند.

- یکپارچگی زنجیره تأمین (Supply Chain Integrity): امنیت باید سختافزار را نیز پوشش دهد. این کار با استفاده از ریشههای اعتماد سختافزاری (Hardware Roots of Trust)، اثبات دانش صفر (Zero-knowledge proofs) و قابلیت ردیابی مبتنی بر بلاکچین انجام میشود تا از مدارهای دستکاری شده جلوگیری شود.

مسیر به سوی نوآوری مسئولانه

امنسازی سیستمهای عصبی صرفاً در مورد جلوگیری از سوءاستفاده نیست؛ بلکه درباره فعالسازی پتانسیل ایمن، فراگیر و تحولآفرین آنها است. با نهادینه کردن انعطافپذیری از سطح تراشه تا سیاستگذاری و با ساخت معماریهای حکمرانی که صنعت، دولتها و جامعه مدنی را همسو میکنند، میتوان اطمینان حاصل کرد که نوروتکنولوژی عزت انسانی را تقویت میکند نه اینکه آن را از بین ببرد.

دهه پیش رو تعیین خواهد کرد که آیا این حوزه به یک شراکت قابل اعتماد بین انسان و ماشین تبدیل میشود یا به مرز جدیدی از آسیبپذیری. مسئولیت این امر جمعی است. اگر با درایت به این موضوع نزدیک شویم، نوروتکنولوژی میتواند در عین حال که نوآوری را پیش میبرد، از هسته اصلی هویت انسانی نیز محافظت کند.

• جمعبندی :

در هسته این چارچوب امنیتی، حکمرانی دادههای عصبی (Neurodata Governance) قرار دارد؛ یعنی رفتار با دادههای مغزی به عنوان زیرساخت حیاتی، با تمرکز بر شفافیت، رضایت آگاهانه و بهحداقلرسانی سختگیرانه دادهها. بدون تدابیر حفاظتی جهانی، خطر پیشرفت نوروتکنولوژی بدون حفظ ماهیت هویت انسانی وجود دارد.

مسئولیت این امر جمعی است. اگر با درایت به این موضوع نزدیک شویم، نوروتکنولوژی میتواند در عین حال که نوآوری را پیش میبرد، از هسته اصلی هویت انسانی نیز محافظت کند و دهه پیش رو تعیین خواهد کرد که آیا این حوزه به یک شراکت قابل اعتماد بین انسان و ماشین تبدیل میشود یا به مرز جدیدی از آسیبپذیری.

———————————————————————————

• نکات کلیدی:

-

بازار جهانی نوروتکنولوژی (Neurotechnology) تا سال ۲۰۳۰ به بیش از ۲۴ میلیارد دلار خواهد رسید و این رشد نیاز به یک چارچوب امنیتی دقیق دارد.

- دلیل اصلی، ماهیت فوقالعاده حساس دادههای عصبی (Neural Data) است که معماری پنهان اندیشه، احساسات و نیات فرد را افشا میکند.

- این دادهها برخلاف رمزهای عبور، در صورت به خطر افتادن، قابلیت بازنشانی ندارند.

- بیش از ۷۰ درصد دستگاههای نوروتکنولوژی تجاری حاوی آسیبپذیریهایی هستند که تهدیداتی مانند «مغزربایی» (Brainjacking) و نظارت عصبی (Neuro-surveillance) را عملی میسازند.

- امنیت در این حوزه مستلزم یک «لایه امنیت عصبی» (Neurosecurity) چندلایه است که حکمرانی دادهها (شفافیت و رضایت) را با حفاظت فنی ترکیب کند.

- حفاظتهای فنی شامل امنیت سیگنال (رمزگذاری سبکوزن)، امنیت هوش مصنوعی (تست متخاصم مدلها) و امنیت ابر و لبه (استفاده از رمزگذاری همومورفیک) میشود.

-

نوروتک مصرفی (هدستهای سلامتی، BCIهای بازی) در حال حاضر در منطقه خاکستری نظارتی باقی ماندهاند.

• نکات تکمیلی:

- Tom Oxley، مدیرعامل Synchron، تأکید میکند که نوروتکنولوژی تنها در صورت اجرای درست حکمرانی و امنیت میتواند به ابزاری تحولآفرین تبدیل شود.

- حملات به پلتفرمهای متصل به ابر میتواند دادههای عصبی را در معرض باجافزارها و نظارت برونمرزی قرار دهد.

-

این لایه حفاظتی باید تا زنجیره تأمین سختافزار (استفاده از ریشههای اعتماد سختافزاری و اثبات دانش صفر) گسترش یابد.

• نتیجه گیری:

نوروتکنولوژی یک شمشیر دولبه است: در حالی که وعده بازیابی عملکردهای انسانی را میدهد، مخاطرات بیسابقهای برای هویت و حریم خصوصی فرد ایجاد میکند. دهههای پیش رو تعیین میکند که آیا این حوزه به یک شراکت قابل اعتماد بین انسان و ماشین تبدیل میشود یا یک مرز جدید آسیبپذیری. با نهادینه کردن «لایه امنیت عصبی» از سطح تراشه تا سیاستگذاری، میتوان اطمینان حاصل کرد که نوآوری با مسئولیتپذیری پیش میرود و هسته اصلی عزت انسانی در برابر حملات Brainjacking و دستکاریهای شناختی حفاظت میشود.

• پرسشهای تحقیقاتی بیشتر:

-

با توجه به نبود مقررات جهانی، چگونه میتوان یک “بیانیه جهانی حقوق عصبی” (Global Neuro-Rights Declaration) را تدوین و اجرا کرد تا در سطح بینالمللی از دادههای عصبی افراد، به ویژه در مناطق بدون قوانین قوی، محافظت شود؟

- چه نوع همکاریهایی بین شرکتهای بزرگ نوروتکنولوژی (مانند Neuralink و Synchron)، نهادهای دولتی و سازمانهای جامعه مدنی برای انجام تستهای تیم قرمز (Red-Teaming) بر روی ایمپلنتهای حیاتی و BCIها لازم است؟

- آیا میتوان با استفاده از فناوری بلاکچین یا دفاتر کل توزیعشده، یک سیستم شفاف و غیرقابل دستکاری برای مدیریت رضایت آگاهانه و مالکیت دادههای عصبی هر فرد ایجاد کرد؟

-

رمزگذاری همومورفیک که امکان تحلیل دادههای رمزگذاریشده را فراهم میکند، تا چه میزان میتواند در محیطهای محدود منابع مانند دستگاههای BCI پوشیدنی پیادهسازی شود؟

• سخن پایانی نویسنده :

به عنوان یک نویسنده علمی، این مقاله من را به شدت به فکر فرو برد. ما در ایران، شاید در خط مقدم استفاده از BCIهای مصرفی یا ایمپلنتهای پیشرفته نباشیم، اما این تهدیدات مرز نمیشناسند. تصور کنید که اطلاعات خام مغزی یک فرد، مثلاً یک محقق یا سیاستمدار، هک شود؛ این دیگر جاسوسی ساده نیست، بلکه سرقت هویت در بنیادیترین شکل آن است. ما در کشور نیازمند بحث و گفتگوی جدی در مورد حقوق عصبی و آمادهسازی زیرساختهای امنیتی برای مقابله با این حملات جدید هستیم، پیش از آنکه این فناوریها به صورت گسترده وارد بازارهای ما شوند.

منبع : به گزارش weforum